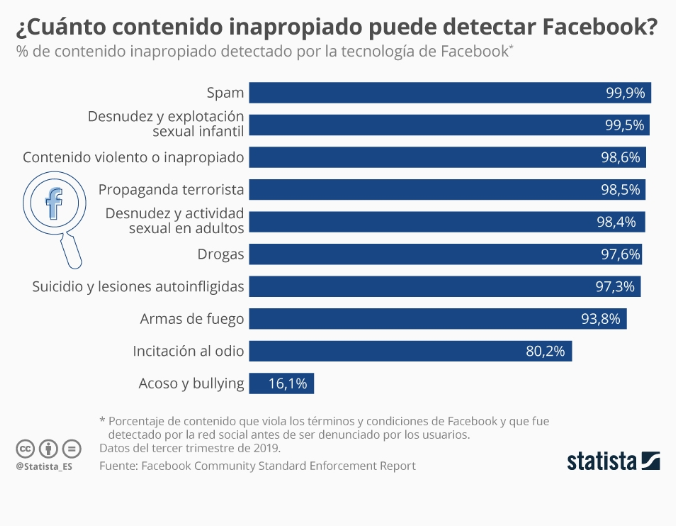

Filtrado de contenido registra baja tasa de éxito.

Con base en tecnología de Inteligencia Artificial (IA), Facebook es capaz de identificar contenido potencialmente dañino para los usuarios, en temas como desnudez y explotación sexual infantil, propaganda terrorista y drogas; sin embargo, la tasa de éxito de la compañía en el filtrado de mensajes categorizados como “incitación al odio”, “acoso y bullying” es una de las más bajas.

“El último informe de Facebook sobre la aplicación de sus términos y condiciones muestra en qué áreas la red social es más eficaz al detectar contenido inapropiado. Para ello, Facebook se vale de una tecnología basada en inteligencia artificial que es capaz de identificar contenidos potencialmente dañinos, con la participación de personas solo en una fase posterior del proceso de revisión”, refiere Statista.

La consultora Statita muestra que mientras que resulta relativamente fácil identificar imágenes que involucran desnudos o violencia gráfica, así como filtrar mensajes de spam, parece mucho más complicado detectar mensajes que incitan al odio, el acoso o la intimidación sin intervención humana.

Tomando como base el número de casos en los que Facebook tomó algún tipo de acción sobre el contenido, la tasa de éxito de la compañía en el filtrado de mensajes categorizados como de “incitación al odio” fue una de las más bajas. En este caso, un 80 por ciento del contenido que incluía este tipo de violencia fue identificado por Facebook antes de que los usuarios lo denunciaran.

“Otro de los principales retos a los que se enfrenta la red social más famosa del mundo para tratar de mantener limpia su plataforma es detectar acoso o bullying en las publicaciones. Como muestra la siguiente infografía de Statista, en esta área Facebook obtuvo un porcentaje de detección de apenas 16 por ciento”.

C$T-GM